La normativa IA per aziende è oggi uno dei temi più strategici per imprenditori e direttori generali visto che l’intelligenza artificiale è già entrata, direttamente e/o indirettamente, nelle PMI delle aziende italiane che governano. Molte PMI la stanno utilizzando per marketing, analisi dati, produzione, logistica, customer care. Alcune lo fanno consapevolmente. Altre senza sapere di essere già soggette alla normativa europea.

Dal 2024 è in vigore il Regolamento (UE) 2024/1689, noto come AI Act. Non tutti sanno che nel 2025 l’Italia ha approvato il proprio disegno di legge di coordinamento e attuazione e che questo significa una cosa molto semplice: l’IA in azienda non è più solo una scelta tecnologica. È una responsabilità giuridica.

In questa guida analizziamo:

- cosa prevede la normativa IA per aziende

- quali obblighi impone l’AI Act

- quando un sistema è ad alto rischio

- come coordinare IA e GDPR

- quali opportunità concrete si aprono per le PMI

- come costruire una governance conforme e competitiva

Cos’è la normativa IA per aziende e perché l’AI Act riguarda anche la tua PMI

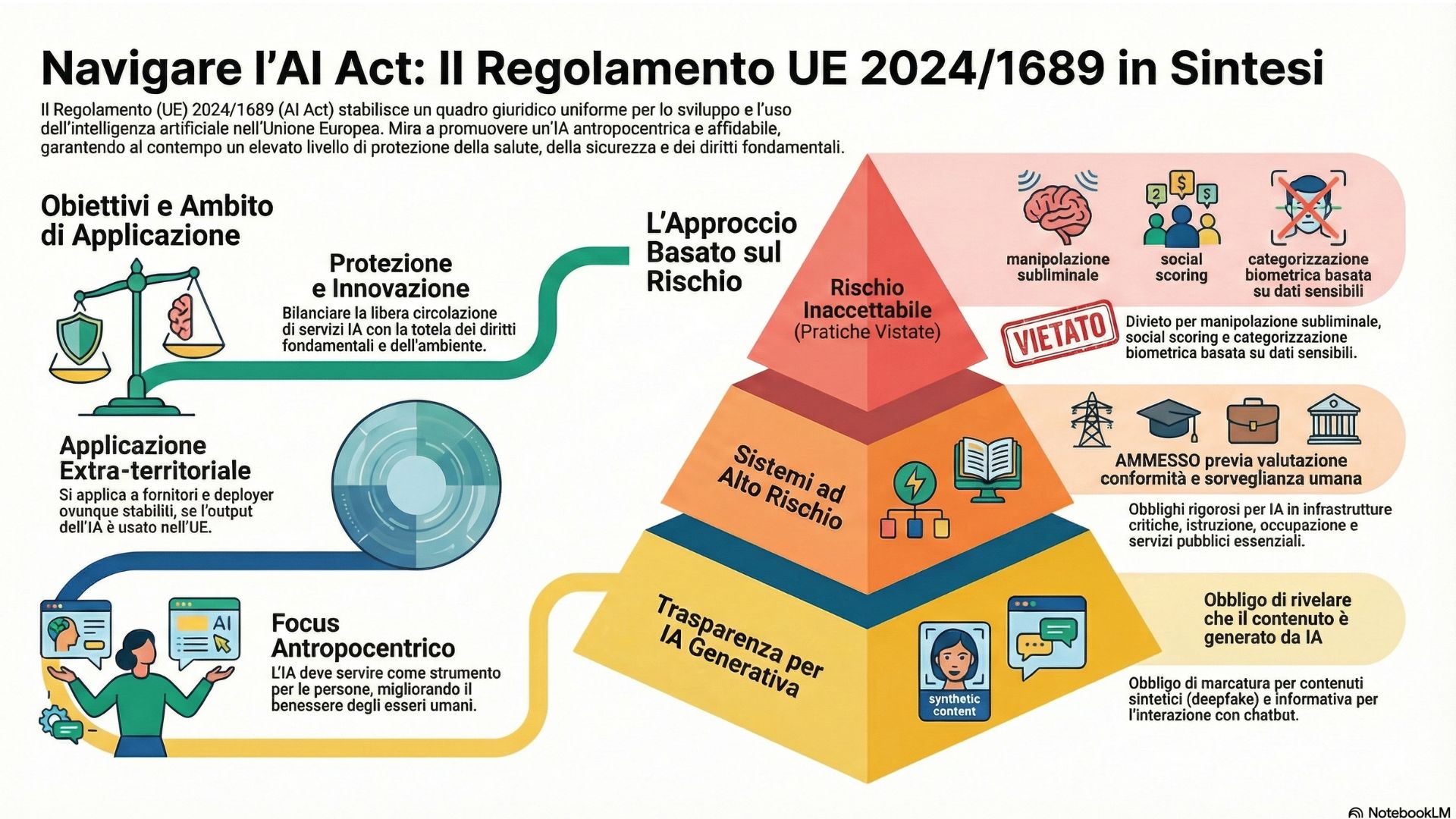

L’AI Act è il primo regolamento al mondo che disciplina in modo organico l’intelligenza artificiale.

Non è una direttiva: è un regolamento europeo direttamente applicabile in tutti gli Stati membri.

Il suo principio centrale è: approccio basato sul rischio

Non tutte le IA sono trattate allo stesso modo. La regolazione aumenta in proporzione al rischio per diritti fondamentali e sicurezza e questo è definito negli articoli 5 e 6 del Regolamento.

Classificazione dei sistemi secondo l’AI Act (art. 5 e 6)

Il regolamento identifica 4 tipologie di sistemi ovvero quelli:

- a rischio inaccettabile (vietati)

- alto rischio

- a rischio limitato

- a rischio minimo

Cerchiamo ora di approfondire per capire che cosa si intende con questa classificazione.

I Sistemi a rischio inaccettabile (vietati)

sulla base dell’articolo 5 dell’ AI Act sono vietati sistemi che:

- manipolano comportamento umano in modo subliminale

- sfruttano vulnerabilità di minori o categorie fragili

- realizzano social scoring

- effettuano identificazione biometrica remota in tempo reale (salvo eccezioni specifiche)

Se la tua PMI utilizza sistemi biometrici o sistemi decisionali automatizzati invasivi, devi verificare con attenzione.

Sistemi IA ad alto rischio

Sulla base dell’ articolo 6 e titolo III del Regolamento rientrano in questa categoria sistemi utilizzati in:

- selezione e gestione del personale

- valutazione creditizia

- infrastrutture critiche

- istruzione

- servizi pubblici essenziali

- dispositivi medici

- sicurezza

Se utilizzi IA per screening CV o scoring clienti, potresti rientrare in questa categoria per cui ti invitiamo a fare molta attenzione.

Sistemi a rischio limitato

Questi sistemi implicano principalmente obblighi di trasparenza come espressamente citato dall’Articolo 52.

Ad esempio:

- chatbot che devono dichiararsi tali

- contenuti generati artificialmente (testi, immagni e/o video)

Sistemi a rischio minimo

Per questa tipolgia di sistemi non esiste nessun obbligo specifico, ma è sempre obbligatorio il rispetto di altre normative (GDPR, sicurezza, responsabilità civile).

Obblighi per aziende con sistemi IA ad alto rischio (art. 9–15)

Se il tuo sistema rientra nella categoria alto rischio, scattano obblighi precisi. Vediamoli nel dettaglio.

Sistema di gestione del rischio (Articolo 9)

L’azienda deve implementare un processo continuo per:

- identificare rischi

- analizzarli

- mitigarli

- monitorarli nel tempo

Non è un documento una tantum. È un processo strutturato.

Governance dei dati (Articolo 10)

I dati utilizzati devono essere:

- pertinenti

- rappresentativi

- privi di bias sistemici

- accurati

Questo punto è cruciale. Un algoritmo non è neutro se i dati di partenza sono distorti.

Documentazione tecnica (Articolo 11)

Deve essere predisposta documentazione che consenta alle autorità di verificare la conformità.

Registrazione automatica (Articolo 12)

Devono essere garantiti log e tracciabilità delle operazioni.

Trasparenza verso utenti (Articolo 13)

Gli utenti devono comprendere:

- funzionamento del sistema

- limiti

- livello di automazione

Supervisione umana (Articolo 14)

Obbligo di human oversight ovvero supervisione umana. Il sistema non può operare senza possibilità di intervento umano significativo. Questo è uno dei punti centrali dell’intera normativa IA aziende.

Robustezza, accuratezza e sicurezza (Articolo 15)

Il sistema deve essere:

- resistente a errori

- sicuro

- protetto contro manipolazioni

Normativa IA per aziende e GDPR: coordinamento obbligatorio

Molti sistemi IA trattano dati personali. In questo caso si applica anche il Regolamento (UE) 2016/679 – GDPR.

La normativa italiana: la legge 132/2025 ribadisce il rispetto integrale del diritto europeo in materia di protezione dati.

Questo comporta:

- base giuridica valida

- finalità determinate

- minimizzazione dei dati

- informativa trasparente

- diritti dell’interessato

Se utilizzi IA per marketing predittivo o scoring clienti, non puoi ignorare questo aspetto.

IA generativa: cosa prevede l’AI Act

L’AI Act introduce disposizioni specifiche per:

- modelli di uso generale (GPAI)

- sistemi generativi

Articoli 52 e 53.

Obblighi:

- dichiarare contenuti generati artificialmente

- rispettare diritto d’autore

- implementare trasparenza adeguata

Se la tua azienda utilizza strumenti come ChatGPT per produzione contenuti, questo ti riguarda.

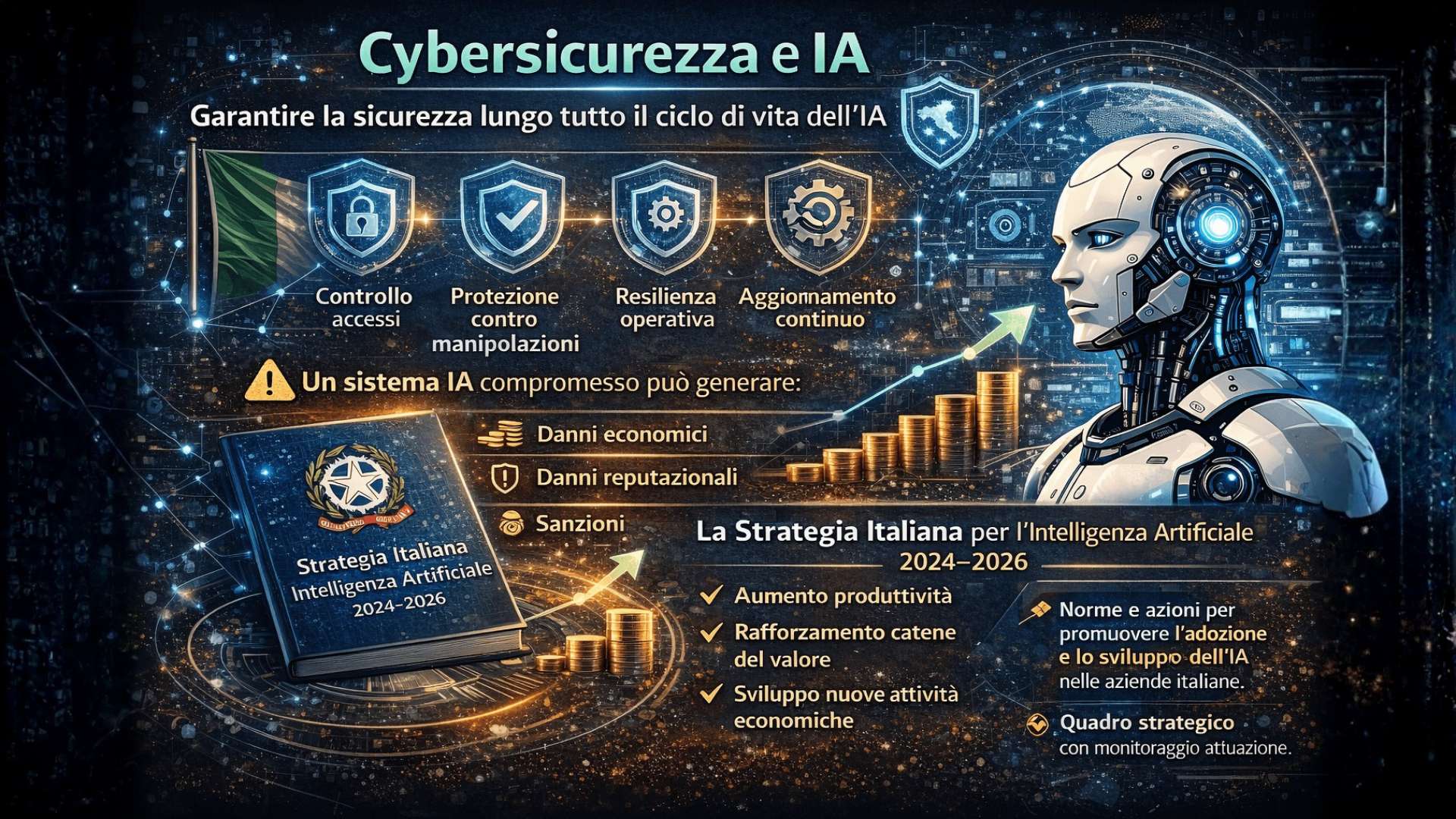

Cybersicurezza e IA

La normativa italiana stabilisce che deve essere garantita la sicurezza lungo l’intero ciclo di vita del sistema.

Questo implica:

- controllo accessi

- protezione contro manipolazioni

- resilienza operativa

- aggiornamento continuo

Un sistema IA compromesso può generare:

- danni economici

- danni reputazionali

- sanzioni

Cybersicurezza e IA

La Strategia Italiana per l’Intelligenza Artificiale 2024–2026 prevede esplicitamente la promozione dell’IA per:

- aumento produttività

- rafforzamento catene del valore

- sviluppo nuove attività economiche

Il documento ufficiale definisce le azioni strategiche e propone un sistema di monitoraggio della relativa attuazione. La normativa non è solo restrittiva, è anche industriale e mira a creare un quadro di riferimento per le imprese italiane in ambito di intelligenza artificiale e cybersecurity.

Governance e normativa IA in azienda: responsabilità dell’imprenditore e del management

Esiste in grosso errore che molte PMI Italiane stanno commettendo ovvero considerare l’IA come un software qualsiasi ed affidare quindi lo sviluppo in azienda di questa area al reparto IT.

Nell’articolo AI per PMI: come introdurre l’intelligenza artificiale senza perdere la motivazione del tuo team abbiamo affontato il tema spiegando che l’evoluzione dell’IA chiede dedizione ma soprattutto consapevolezza in chi guida l’azienda. Questo è un passo fondamentale sia per non incorrere in sanzioni, in questa guida ti stiamo spiegando bene le basi su cui fontare il tuo sviluppo sul tema, che per consentire alla tua azienda di rimanere competitiva.

La normativa richiede:

- supervisione umana

- responsabilità chiara

- tracciabilità decisionale

Questo significa leadership.

Un imprenditore deve:

- comprendere classificazione rischio

- definire policy interne

- stabilire limiti

- monitorare impatto

Non serve diventare un tecnico, serve diventare consapevole.

Checklist operativa di conformità normativa IA per PMI

- Mappatura sistemi IA utilizzati

- Classificazione secondo AI Act

- Verifica trattamento dati personali

- Analisi rischio e bias

- Implementazione supervisione umana

- Documentazione tecnica

- Policy interne IA

- Controllo cybersicurezza

- Formazione del management

- Monitoraggio continuo

Sanzioni previste dall’AI Act: cosa rischia la tua azienda

La normativa IA per aziende non è solo un impianto teorico essa infatti prevede sanzioni amministrative molto rilevanti.

L’articolo 99 del Regolamento (UE) 2024/1689 stabilisce tre livelli sanzionatori:

- le violazioni più gravi, tra cui l’utilizzo di sistemi vietati (art. 5), comportano sanzioni fino a 35 milioni di euro oppure al 7% del fatturato annuo globale, se superiore

- violazioni relative agli obblighi dei sistemi ad alto rischio comportano sanzioni fino a 15 milioni di euro oppure al 3% del fatturato globale

- per informazioni scorrette fornite alle autorità la sanzione arriva fino a 7,5 milioni di euro oppure 1% del fatturato globale

Questo dato cambia la tua prospettiva? L’IA non è più solo una leva di innovazione. È un ambito di responsabilità diretta dell’organo amministrativo.

Conclusione: conformità e competitività non sono opposte

La normativa IA per aziende non nasce per rallentare l’innovazione. Nasce per renderla sostenibile.

L’AI Act non ti chiede di smettere di innovare. Ti chiede di farlo con metodo, responsabilità e tracciabilità. La differenza tra chi subirà la normativa e chi la trasformerà in vantaggio competitivo sta nella governance.

Le PMI che:

- comprendono la classificazione del rischio

- implementano supervisione umana

- documentano processi

- formano il management

costruiscono un sistema più solido, più credibile e più difendibile sul mercato.

In un contesto europeo che punta a un’AI affidabile e trasparente, la conformità diventa un asset reputazionale.

La vera domanda non è: “Come evitare la sanzione?”

La vera domanda è:

Come usare la conformità per rafforzare il posizionamento della mia azienda?

L’algoritmo è uno strumento.

La governance è una scelta imprenditoriale.

FAQ – Normativa IA Aziende

Vorresti implementare l’IA nella tua azienda ma non sai come fare?

PS. Questo articolo è stato redatto sotto la responsabilità dell’autore con il supporto di strumenti di intelligenza artificiale per l’elaborazione e l’organizzazione delle informazioni, nel rispetto delle normative vigenti. Le immagini presenti in questa pagina sono state generate con strumenti di intelligenza artificiale a scopo illustrativo.